拒绝小扎15亿美元offer的大佬,还是加入Meta了

拒绝小扎15亿美元offer的大佬,还是加入Meta了那个拒绝了小扎15亿美元薪酬包的机器学习大神,还是加入Meta了。OpenAI前CTO Mira Murati创业公司Thinking Machines Lab证实,联创、首席架构师Andrew Tulloch已经离职去了Meta。

那个拒绝了小扎15亿美元薪酬包的机器学习大神,还是加入Meta了。OpenAI前CTO Mira Murati创业公司Thinking Machines Lab证实,联创、首席架构师Andrew Tulloch已经离职去了Meta。

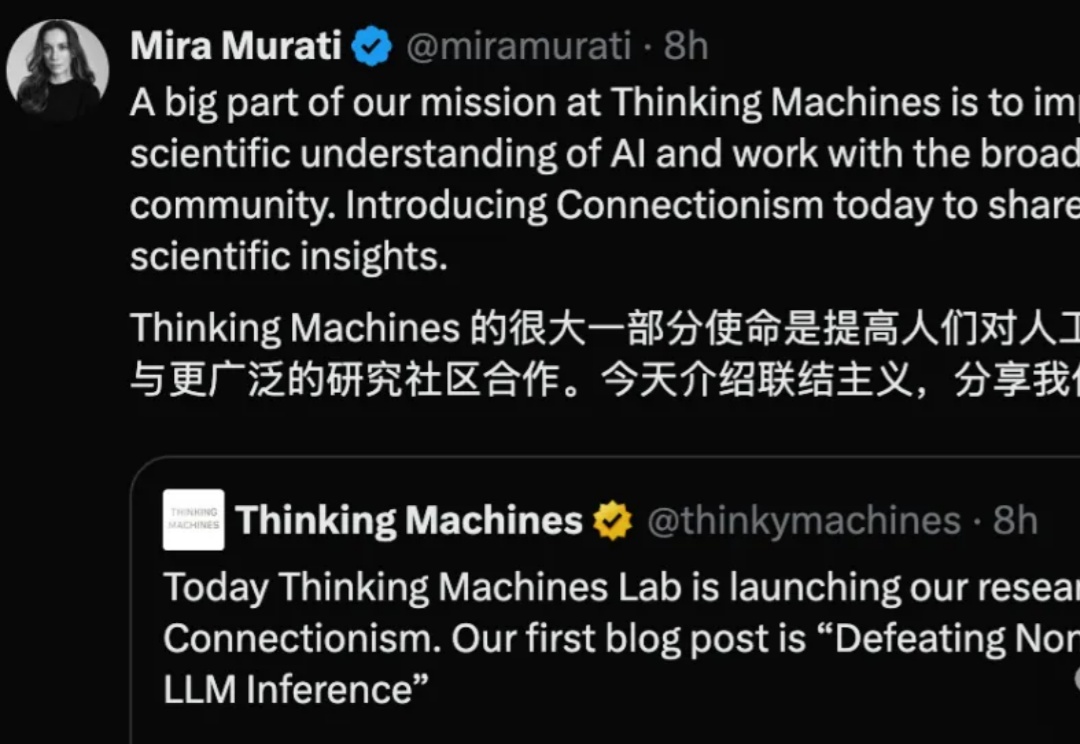

Thinking Machines Lab发布首个产品:Thinker,让模型微调变得像改Python代码一样简单。也算是终于摘掉了“0产品0收入估值840亿”的帽子。Tinker受到了业界的密切关注。AI基础设施公司Anyscale的CEO Robert Nishihara等beta测试者表示,尽管市面上有其他微调工具,但Tinker在“抽象化和可调性之间取得了卓越的平衡”

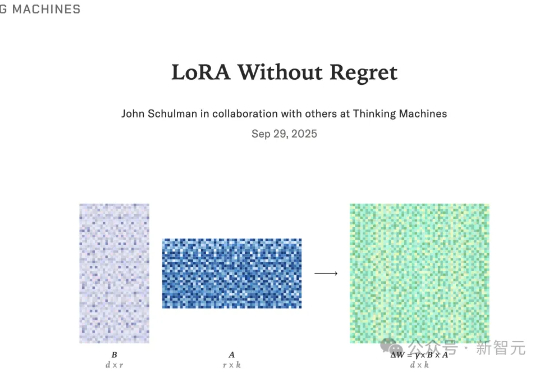

LoRA能否与全参微调性能相当?在Thinking Machines的最新论文中,他们研究了LoRA与FullFT达到相近表现的条件。Thinking Machines关注LoRA,旨在推动其更广泛地应用于各种按需定制的场景,同时也有助于我们更深入审视机器学习中的一些基本问题。

一个月前,我们曾报道过清华姚班校友、普林斯顿教授陈丹琦似乎加入 Thinking Machines Lab 的消息。有些爆料认为她在休假一年后,会离开普林斯顿,全职加入 Thinking Machines Lab。

明星创业公司Thinking Machines,第二篇研究论文热乎出炉!公司创始人、OpenAI前CTO Mira Murati依旧亲自站台,翁荔等一众大佬也纷纷转发支持:论文主题为“Modular Manifolds”,通过让整个网络的不同层/模块在统一框架下进行约束和优化,来提升训练的稳定性和效率。

在大模型训练时,如何管理权重、避免数值爆炸与丢失?Thinking Machines Lab 的新研究「模块流形」提出了一种新范式,它将传统「救火式」的数值修正,转变为「预防式」的约束优化,为更好地训练大模型提供了全新思路。

宝可梦游戏的开放世界、长周期、巨大行动空间和高难度特性,为训练能应对现实世界复杂性(如稀疏奖励、探索挑战)的AI提供了理想沙盒。对比AI的机械尝试和人类的“乐趣驱动”探索,文章阐释人类特有的好奇心美学对于科学发现的关键价值,并探讨AI赋能游戏设计(个性化体验、无限故事/行动空间)以优化人类乐趣的潜力。

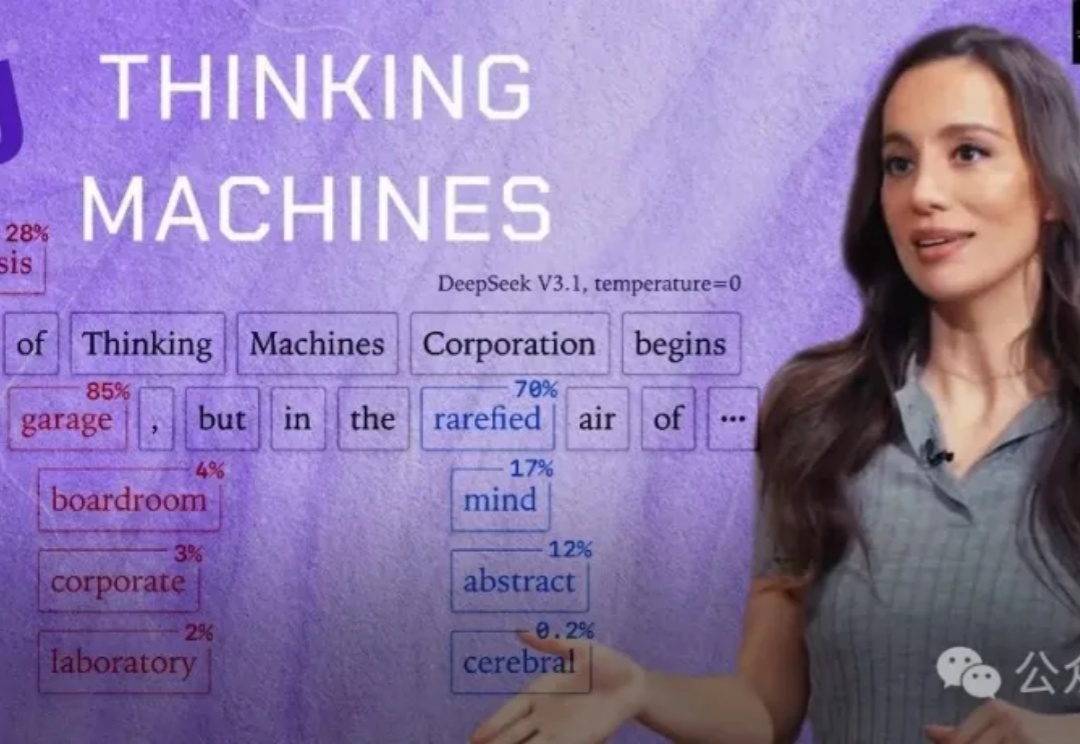

Thinking Machines Lab成立7个月,估值120亿美元,首次公开研究成果:LLM每次回答不一样的真凶——kernel缺乏批处理不变性。Lilian Weng更是爆猛料:首代旗舰叫 Connection Machine,还有更多在路上。

刚刚,0产出估值就已冲破120亿美元的Thinking Machines,终于发布首篇研究博客。

又一个AI学术大佬,有工业界身份了。 清华姚班校友、普林斯顿教授陈丹琦,跟Thinking Machines划上了关联。